La tecnología no es neutral. Los algoritmos no surgen en el vacío. Los modelos de IA aprenden de datos históricos y son entrenados y ajustados por equipos humanos. Si esos equipos cargan con sesgos ideológicos, culturales y de género así sea de forma inconsciente, los sistemas que construyen pueden replicar e incluso amplificar desigualdades existentes.

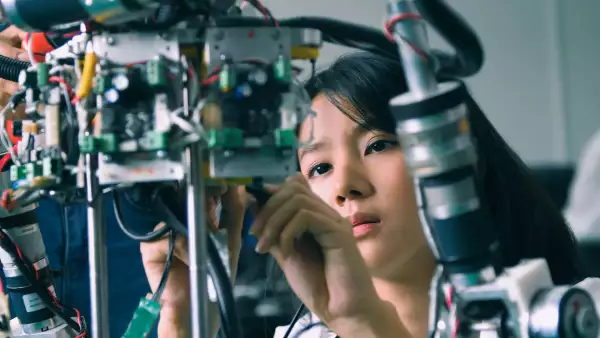

Según datos de la UNESCO, sólo 3 de cada 10 profesionales en áreas STEM son mujeres y apenas el 35% del personal investigador es femenino. En el desarrollo de software, ciencia de datos o ciberseguridad, la proporción suele ser menor. La brecha se profundiza en posiciones de liderazgo técnico y toma de decisiones estratégicas.

Esto no es solo un problema de representación. Es un problema de poder.

Hoy las industrias clave en México están siendo redefinidas por la IA: servicios financieros, retail, salud, manufactura, recursos humanos. Desde motores de calificación crediticia hasta algoritmos de reclutamiento, las decisiones automatizadas influyen en quién obtiene un crédito, quién accede a un empleo y qué oportunidades se visibilizan.

Si los equipos que desarrollan estas herramientas no cuestionan sus sesgos ni revisan críticamente los datos que utilizan, el riesgo es evidente. Los datasets contienen huellas de desigualdades históricas: menor acceso de mujeres a financiamiento, menor presencia en posiciones técnicas, trayectorias interrumpidas por cargas de cuidado. Si estos patrones se integran sin ajustes en los modelos, la IA no solo reflejará la desigualdad: la automatizará y la escalará.

Pero la IA también puede convertirse en una herramienta para reducir las brechas.

Puede utilizarse para detectar diferencias salariales internas, identificar patrones de promoción desiguales, eliminar lenguaje excluyente en vacantes y diseñar procesos de selección más estructurados y objetivos. Puede ayudar a hacer visibles los sesgos y corregirlos. La diferencia está en la intención estratégica de las organizaciones y, sobre todo, en quién participa en el diseño de estas soluciones.